Emotion AI ในการตลาด เข้าถึงอารมณ์ลูกค้าด้วย Image Processing

สวัสดีค่ะทุกท่าน,,,, เข้าสู่เนื้อหาที่นิกคิดว่าน่าสนใจมากๆ สำหรับนักการตลาดในยุค Digital Marketing ซึ่งก็คงหนีไม่พ้นจากอะไรล้ำๆ อย่างการใช้งานความสามารถของ AI ซึ่งในบทความนี้จะพาทุกท่านไปสำรวจ วิเคราะห์ และจัดเก็บอารมณ์ของลูกค้าในขณะที่ใช้งานบริการ ซื้อสินค้า หรือแพลตฟอร์ม ผ่านการประมวลผลภาพ (Image Processing) ด้วยหลักการที่เรียกว่า Emotions AI ค่ะ

ทำความรู้จัก Emotion AI

Emotion AI เป็นเทคนิคที่ถูกออกแบบมาเพื่อให้ทำความรู้จัก ตีความ, ประมวลผล และอาจรวมถึงความสามารถในการจำลองอารมณ์ของมนุษย์ โดยเทคโนโลยีนี้สามารถวิเคราะห์และตอบสนองต่ออารมณ์ของมนุษย์ผ่านการแสดงออกทางใบหน้า, น้ำเสียง, ภาษากาย หรือแม้กระทั่งข้อความที่เรากรองมาจาก Social Network แพลตฟอร์มต่างๆ

ซึ่งสิ่งนี้เองค่ะ ที่ทำให้การวิเคราะห์อารมณ์ด้วย AI ในรูปแบบนี้มีความสำคัญ และมีศักยภาพในการช่วยเราวิเคราะห์ข้อมูลหลายๆ ด้าน โดยเฉพาะอย่างยิ่งในด้านการตลาด ยกตัวอย่างการใช้งาน เช่น

- การวิเคราะห์ปฏิกิริยาของลูกค้าที่มีต่อผลิตภัณฑ์:

AI Emotional สามารถใช้วิเคราะห์การแสดงออกทางใบหน้าของลูกค้าเมื่อลูกค้าของเราสัมผัส หรือทดลองใช้ผลิตภัณฑ์ ซึ่งช่วยให้แบรนด์สามารถเข้าใจถึงอารมณ์ และปฏิกิริยาของลูกค้าต่อผลิตภัณฑ์ได้อย่างดีมากยิ่งขึ้น - ปรับปรุงการประชาสัมพันธ์และโฆษณา:

โดยการวิเคราะห์อารมณ์ของผู้บริโภคจากข้อมูลที่ได้รับจากแหล่งข้อมูลต่างๆ เช่นแบบสำรวจ คอมเมนต์ หรืออื่นๆ ทำให้เราสามารถปรับแต่งเนื้อหาโฆษณาหรือแคมเปญการตลาดให้ตอบโจทย์ และกระตุ้นอารมณ์ของลูกค้ากลุ่มเป้าหมายได้ดียิ่งขึ้น - การวิเคราะห์ปฏิสัมพันธ์กับลูกค้า:

AI Emotional ช่วยในการวิเคราะห์การโต้ตอบและการสื่อสารกับลูกค้าของแบรนด์ เช่น วิเคราะห์การตอบสนองต่อการบริการลูกค้า ผ่านช่องทางการประเมินความพึงพอใจหลังการซื้อ หรือการเก็บข้อมูลจากการสนทนากับลูกค้าเป็นต้น - ปรับปรุงประสบการณ์การซื้อ:

การใช้ AI Emotional ในร้านค้า หรือในแพลตฟอร์ม สามารถใช้เพื่อช่วยวิเคราะห์อารมณ์ของลูกค้าขณะ Shopping ซึ่งจะช่วยให้นักการตลาดสามารถสร้าง Experience ที่ดีให้กับลูกค้าได้

ซึ่งในบทความนี้ นิกจะพาทุกท่านไปเจาะลึกถึงการใช้งาน AI ตัวนี้ในรูปแบบของการใช้ร่วมกับเทคนิคการประมวลผลภาพ เพื่อเรียนรู้ และจดจำใบหน้า ว่าถ้าลูกค้าของเราแสดงออกด้านหน้าตาแบบนี้ หมายความว่าลูกค้ารู้สึกอย่างไร ที่มีชื่อเรียกเทคนิคอย่างเป็นทางการว่า “AI emotion recognition” ค่ะ (≧∀≦)ゞ

เทคนิคการประมวลผลและจดจำอารมณ์ AI emotion recognition 😊😆😵😱

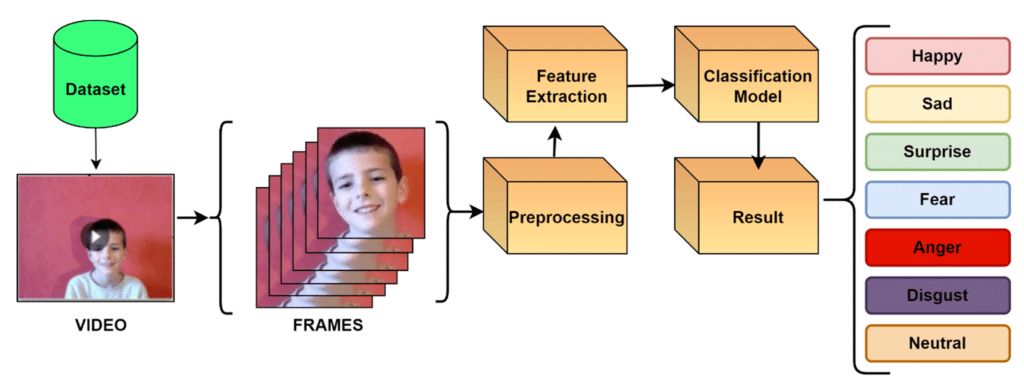

การประมวลผล และจดจำอารมณ์ด้วย AI “AI emotion recognition” ใช้หลักกการทำ Image Recognition ในการอ่านอารมณ์จากการแสดงออกทางใบหน้าของเรา ซึ่งถือว่าเป็นกระบวนการที่ซับซ้อนมากๆ ค่ะทุกท่าน โดยการทำ Emotion recognition จะใช้ ML Model ที่เป็น Deep Learning ในการวิเคราะห์และตีความอารมณ์ของมนุษย์

โดยหลักการพื้นฐานของ Emotion Recognition สามารถแบ่งเป็น 3 ส่วนหลักๆ ดังนี้

(ป.ล. บางค่ายหรือบางบทความอาจแบ่งไม่เหมือนกันนะคะ,, แต่โดยรวมก็จะคล้ายกัน,, เผื่อเพื่อนๆ ไปอ่านเจอที่อื่นจะได้ไม่สับสน)

#1 การรวบรวมข้อมูล:

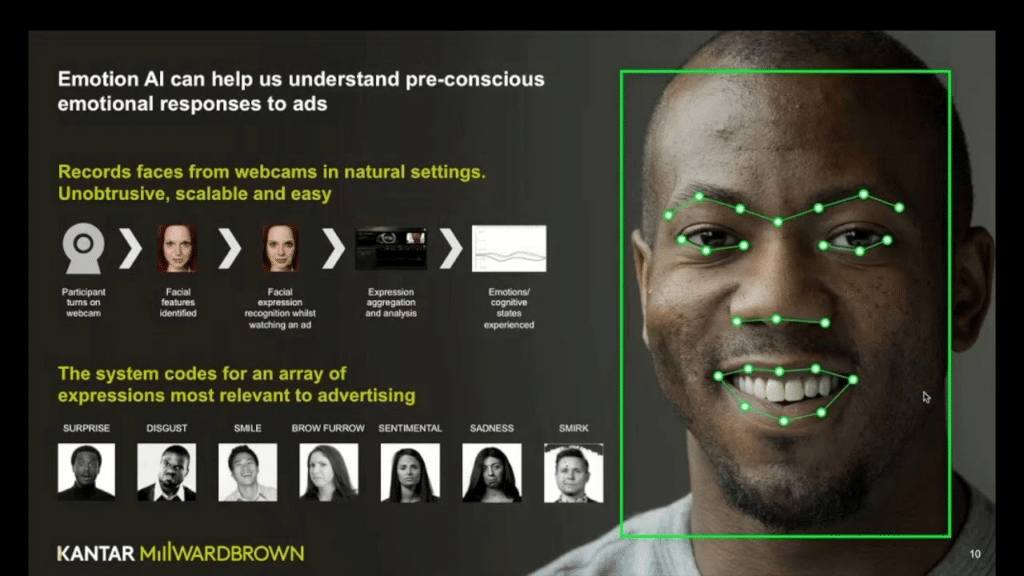

- ข้อมูลภาพ (Visual Data): ในที่นี่คือภาพจาก Webcam หรือกล้องวิดีโอต่างๆ ที่เป็นการแสดงออกทางใบหน้า, ท่าทาง และการเคลื่อนไหว ทั้งแบบวิดีโอที่ถูกบันทึก หรือภาพนิ่งของลูกค้าในกรณีที่ต้องการวิเคราะห์ย้อนหลังผ่าน Data แล้วจัดเก็บหลังการประมวลผลเสร็จลง Database หรือจะทำการวิเคราะห์แบบ Real-time ก็ได้

- ข้อมูลเสียง (Audio Data): เช่น น้ำเสียง และความเร็วในการพูด ซึ่งบันทึกผ่านไมโครโฟนเป็นต้น (แต่ในบทความนี้จะเน้น Visual Data เป็นหลักนะคะ)

#2 การประมวลผลข้อมูล:

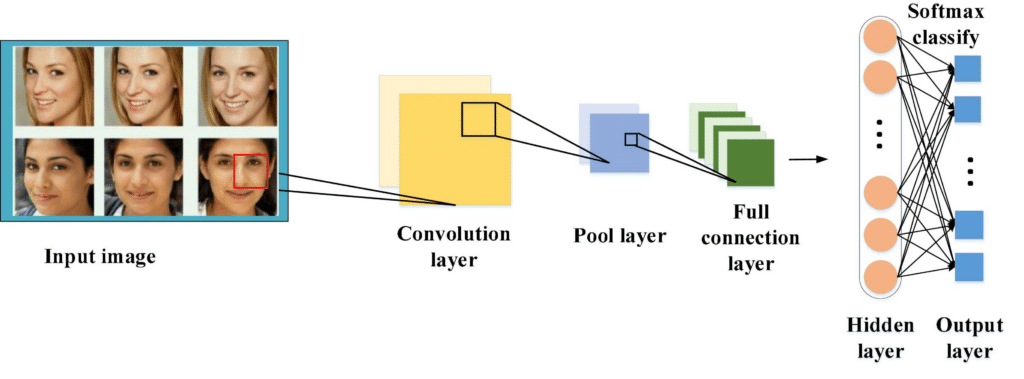

- การตรวจจับใบหน้าและการแสดงออก (Face Detection and Expression Analysis): ใช้โมเดล AI ในการระบุ และวิเคราะห์การแสดงออกทางใบหน้า แบบ Deep Learning โดยโมเดลที่เป็นที่นิยมเช่น Convolutional Neural Networks หรือ CNNs ที่ประกอบด้วยเทคนิคหลักคือ แยกแยะลักษณะพิเศษและองค์ประกอบบนใบหน้า และการเปลี่ยนแปลงหรือ Movement ในการแสดงออกของสีหน้า

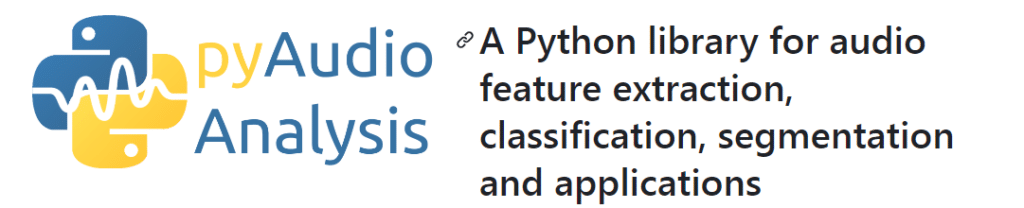

- การวิเคราะห์เสียง (Audio Analysis): โดยในส่วนนี้ก็จะใช้ร่วมกับ Audio Data ที่จัดเก็บมา ซึ่งสำหรับท่านใดที่อยากทดลองทำ Feature Extraction, Classification หรืแ Segmentation ด้วย Python สามารถดาวน์โหลด Github นี้มาลองได้เลยค่ะ^^

#3 การตีความและจำแนกอารมณ์:

- การจำแนกอารมณ์ (Emotion Classification): โดยการทำงานของโมเดลนี้ คือหลังจากที่ระบบได้รับข้อมูลจากขั้นตอน Face Detection ตัว Emotion Classification ก็จะทำการวิเคราะห์ข้อมูลเหล่านั้นผ่าน Algorithm ที่เราเลือกที่จะใช้ เพื่อทำการระบุลักษณะที่เป็นเอกลักษณ์ของอารมณ์ต่างๆ จากข้อมูลที่ได้รับ แล้วจึงทำการจำแนกอารมณ์ที่ Predict ได้ เช่น มีความสุข, เป็นเศร้า, โกรธ, สับสน หรือประหลาดใจ ออกมาค่ะ

- การใช้ Deep Learning: และในกรณีที่เราต้องการทำ Prediction ของอารมณ์ที่มีความแม่นยำมากยิ่งขึ้น จะใช้ร่วมกับ Deep Learning Model เช่น Recurrent Neural Networks (RNNs) สำหรับการวิเคราะห์ลำดับของข้อมูลเวลา (เช่น, การเปลี่ยนแปลงของอารมณ์ในช่วงเวลาหนึ่ง) ซึ่งช่วยให้เราสามารถทำนายอารมณ์และการตอบสนองของลูกค้าที่จะเกิดขึ้นในอนาคตได้

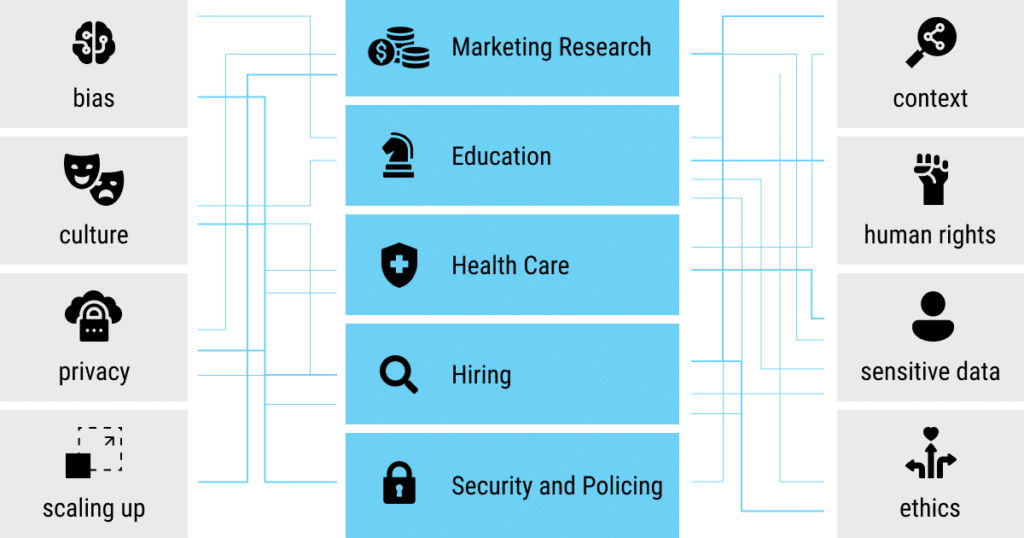

อย่างไรก็ตามค่ะทุกท่าน ใช่ว่าการใช้งาน AI ในการเรียนรู้ จดจำ และวิเคราะห์อารมณ์ของลูกค้าให้เราจะมีเพียงข้อดีเท่านั้น แต่ในการใช้งานจริงยังไมีสิ่งที่ต้องคำนึงดังนี้ค่ะ

- ความแม่นยำ: ขึ้นอยู่กับคุณภาพของข้อมูลและความสามารถของโมเดลที่เรา Train มา

- Bias: เนื่องจากในปัจจุบัน หากเราต้องการทำ Transfer Learning (หรือพูดง่ายๆ ว่าเอาโมเดลเค้ามาใช้ต่อ) อาจมีปัญหาเกี่ยวกับความเอนเอียงทางเชื้อชาติหรือเพศในการจดจำอารมณ์ได้ เพราะอย่างที่เราทราบกันดีค่ะว่า หน้าตา และการแสดงออกทางอารมณของคนแต่ละเชื้อชาติก็ไม่เหมือนกัน

- ความเป็นส่วนตัวและจริยธรรม AI: สิ่งนี้ถือเป็นประเด็นที่เปราะบาง และอ่อนไหวที่เราต้องให้ความสำคัญและระมัดระวังมาก เพราะข้อมูลที่เราเอามาวิเคราะห์เหล่านี้ถือเป็นข้อมูลส่วนบุคคลที่ต้องทำตามกรอบ PDPA และธรรมาภิบาลข้อมูลอย่างเคร่งครัด

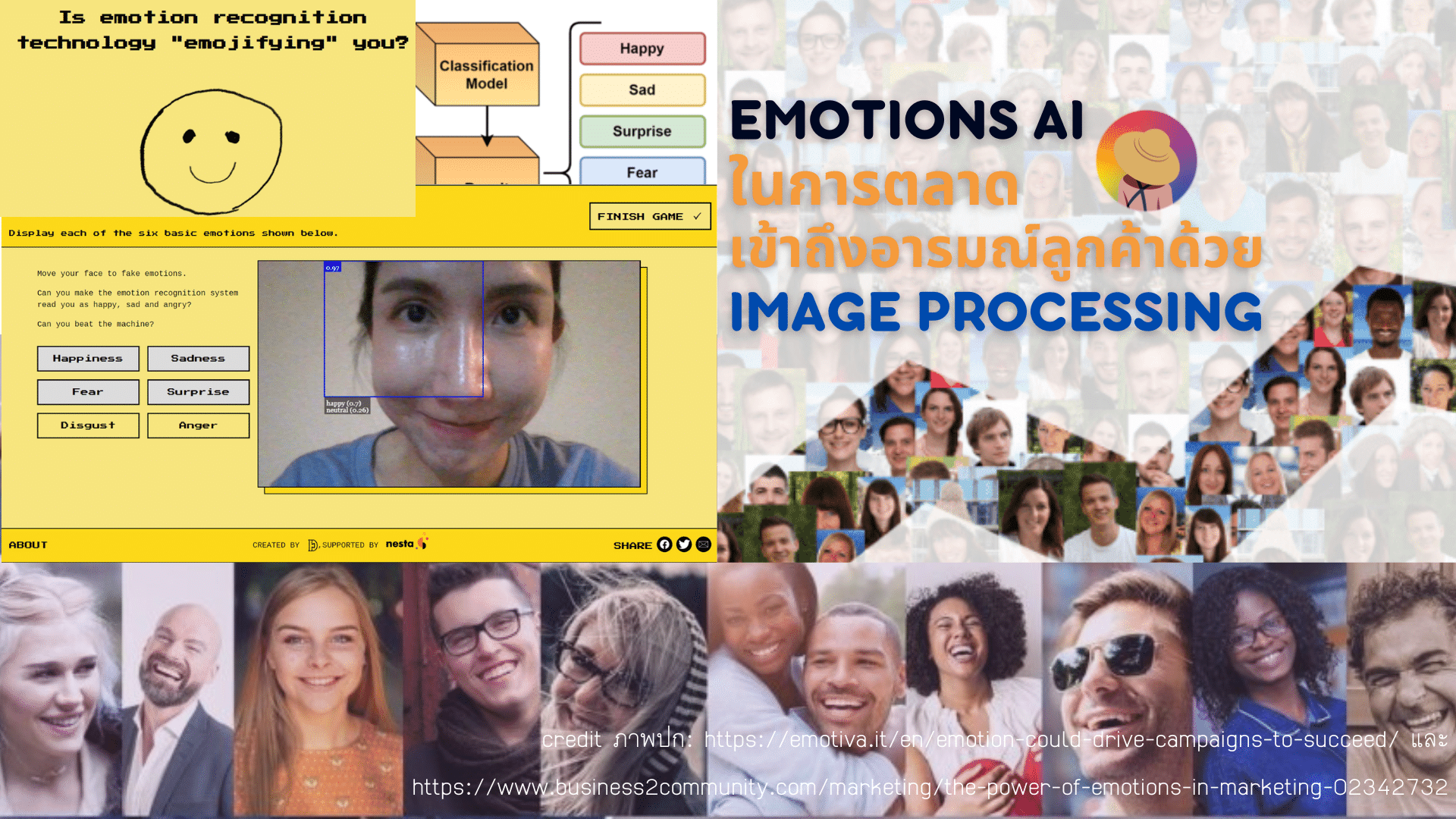

มาทดลองใช้งาน Emotion Recognition System กันค่ะ^^

เพื่อให้ทุกท่านเห็นภาพที่ชัดเจนมากยิ่งขึ้นของการทำ Emotions AI นิกเลยมีแพลตฟอร์มที่เป็นงานวิจัยจาก nesta ที่ชื่อว่า “emojify” มาให้เข้าไปลองเล่นกันง่ายๆ โดยสามารถเข้าไปที่ Link:

https://emojify.info/ 😊☺😄😎

ซึ่งเมื่อเข้ามาแล้วจะมาเจอกับหน้าตากของน้อง Emojify ตามภาพด้านล่าง ซึ่งก็ให้เราสามารถกด Enter* เข้าไปได้เลยค่ะ^^

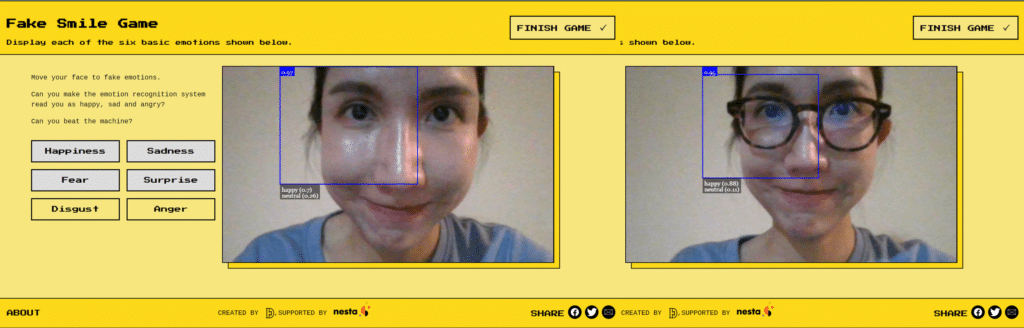

โดยหลักการของ Emojify ก็จะเหมือนกันสิ่งที่พวกเราต้องการจะนำไปใช้เพื่อวิเคราะห์อารมณ์ของลูกค้าเลย นั่นคือ เค้าจะพยายาม Recognize ให้ได้ว่าสีหน้าที่เรากำลังแสดงออกอยู่ตอนนี้หมายความว่าเรากำลัง,,,, Happiness 😄, Sadness😥, Fear 😫, Surprise 🤩, Disgust 🙄 หรือ Anger 😤

ซึ่งจากตรงนี้ถ้าพวกเราต้องการปรับจูน Deep Learing Model ของเราให้มีความจำเพาะเจาะจงมากขึ้น หรือแม้แต่ลดจำนวนของ Emotion Segment ก็สามารถทำได้เช่นเดียวกันนะคะ =>> แต่ต้อง Train Model เอง 555+ ซึ่งส่วนตัวนิกแนะนำเป็น OpenCV ค่ะ เข้าใจได้ไม่ยากนัก โดยถ้าเพื่อนๆ อยากลองศึกษาดูสามารถเข้าไปลองทำตามวิดีโอนี้ได้เลยค่ะ,,,, รับรองว่าไม่ยาก ( •̀ ω •́ )✧

กลับเข้ามาต่อในเรื่องของเรา และ Emojify ที่เมื่อเรา Enter* เข้าไปแล้ว เค้าก็จะถามเราเพื่อให้เราทำการเปิดกล้อง ก็ให้เรา Allow ไปนะคะ หลังจากนั้นก็ลองดูผลลัพธ์เป็นการ Predict อารมณ์จากกล้องแบบ Real-time ได้เลยค่ะ

ซึ่งในส่วนนี้นิกลองพลีชีพ 55+ ทดสอบความแม่นยำให้เพื่อนๆ โดยคิดว่าอารมณ์ที่ลูกค้าน่าจะแสดงออกตอนชำระเงินค่าสินค้ามีดังนี้

#Happiness 😄: แฮปปี้สุดๆ ถูกและดีเวอร์

โดยสิ่งที่นิกอย่างรู้คือ ระหว่างใส่แว่น และไม่ใส่แว่น ตัวผลลัพธ์ที่ได้จาก Model จะมีความแตกต่างกันมากน้อยขนาดไหน ซึ่งพบว่าตอนที่ไม่ใส่แว่นโมเดลทำนายเป็น Happy 0.7 Neutral 0.26 และในขณะที่ใส่แว่นโมเดลทำนายเป็น Happy 0.88 Neutral 0.11 ทำให้เราอาจสามารถตั้งสมมุติฐานเพิ่มเติมได้ว่าการมีองค์ประกอบบนใบหน้าใหม่ๆ เช่น แว่น-ไม่แว่น, หมวก-ไม่หมวก หรืออื่นๆ อาจมีผลต่อผลลัพธ์ได้ (แต่อย่างไรก็ตามนิกขอ Notation ไว้เพิ่มเติมนะคะว่า สีหน้าที่แสดงออกไปในทั้ง 2 ภาพก็ไม่เหมือนกัน 100% ค่ะ^^)

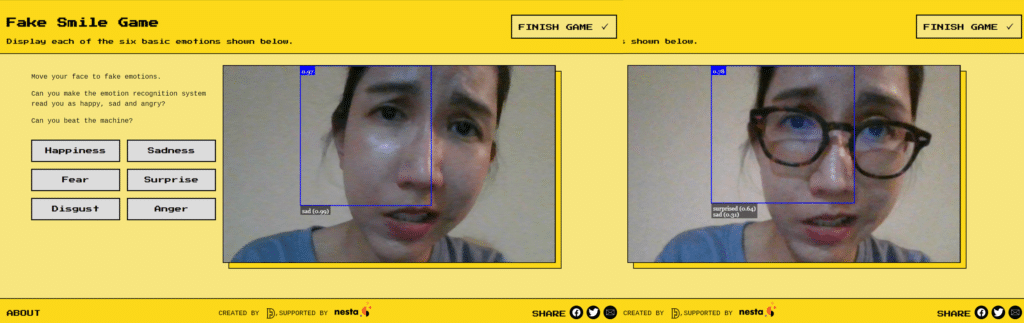

# Disgust 🙄: ฮะ!! อะไรนะ ราคายังไงนะ?

อันนี้พลีชีพตอนงงราคาเลยค่ะ ซึ่งส่วนตัวคิดว่าลูกค้า หรือแม้แต่พวกเราเองน่าจะเจอกับเหตุการณ์ ได้ยินราคาแล้วเกิดอาการ “ฮะ!!” ได้บ่อยพอๆ กับ Happy ซึ่งจากผลลัพธ์พบว่าตอนที่ไม่ใส่แว่นโมเดลทำนายเป็น Sad 0.99 (โถ,,,, อะไรจะเป็นเศร้าขนาดนั้น) และในขณะที่ใส่แว่นโมเดลทำนายเป็น Surprised 0.64 Sad 0.31 ซึ่งเป็นการตอกย้ำค่ะ ว่าการองค์ประกอบอื่นบนใบหน้า มีผลต่อความแม่นยำของโมเดลจริง

และผลลัพธ์จากโมเดลใดๆ ก็ตามควรมีส่วนประกอบของการ Get Feedback เพื่อปรับปรุงความแม่นยำของตัว Model ด้วยค่ะ ( ̄︶ ̄)↗

แนวทางการใช้ข้อมูลจาก Emotions AI ในการตลาด

เมื่อทุกท่านเห็นภาพ และลักษณะของผลลัพธ์ที่ได้ออกมาจาก Emotion Recognition System กันแล้ว ในส่วนสุดท้ายนี้เราจะมาเข้าสู่สิ่งสำคัญคือ,,,, แนวทางในการใช้ข้อมูลจาก Emotion Recognition เพื่อทำการตลาดในยุค Digital Marketing กันค่ะ^^ ,,,, Let’s go (/≧▽≦)/

- กำหนดเป้าหมาย: ขั้นตอนแรกนี้ คือการกำหนดว่าเราต้องการทำอะไรด้วย Emotion AI เช่น ต้องการเพิ่ม Engagement ของลูกค้า ต้องการปรับปรุงประสิทธิภาพของ Ads หรือต้องการมอบประสบการณ์แบบ Personalized มากยิ่งขึ้น โดยเป้าหมายนี้เองค่ะ ที่จะเป็นแนวทางในการกำหนดกลยุทธ์และผลลัพธ์ที่เราต้องการได้จาก Emotion Recognition System

- เข้าใจ Emotional landscape: ในส่วนนี้ นิกอยากจะบอกทุกท่านว่า ถึงแม้ว่าเราจะมีระบบ Emotion Recognition แต่อย่างไรก็ตามการใช้ข้อมูลที่มีอยู่อื่นๆ ร่วมด้วย เช่น—ข้อเสนอแนะจากลูกค้า, ความคิดเห็นบนโซเชียลมีเดีย ก็เป็นองค์ประกอบที่สามารถทำให้เราวิเคราะห์ได้เพิ่มเติม และเจาะลึกยิ่งขึ้นไปอีกว่า อะไรที่กระตุ้นความรู้สึกบวก หรือลบต่อแบรนด์ ผลิตภัณฑ์หรือแคมเปญ

- เลือก Emotion AI Tools ที่เหมาะสม: หลังจากที่เรากำหนดเป้าหมาย และเข้าใจลูกค้าของเราแล้ว ขั้นตอนที่สำคัญต่อไปคือการเลือก AI Tools (หรือ Model ถ้าเรา Code เอง) ที่เหมาะสมกับลักษณะของข้อมูล และผลลัพธ์ที่เราต้องการ เพราะบางแพลตฟอร์มอาจมุ่งเน้นการวิเคราะห์ข้อความ ในขณะที่บางแพลตฟอร์มมีจุดเด่นในการตีความการแสดงออกทางใบหน้าหรือน้ำเสียง

- Testing: และขั้นตอนนี้ถือเป็นขั้นตอนที่สำคัญก่อนที่เราจะ Apply โมเดลของเรา หรือ Integrate แต่ละ Tools ที่เราเลือกใช้เข้าด้วยกัน โดยสิ่งที่เราจะต้องทำก็คือการทดสอบกับกลุ่มลูกค้า กลุ่มเล็กๆ หรือระบุกรอบในการใช้งานก่อน เพื่อปรับปรุงจุดผิดพลาดก่อนนำออกไปใช้งานจริงในวงกว้าง

- วิเคราะห์ผลลัพธ์: ก็ตามชื่อค่ะ คือการวิเคราะห์ผลลัพธ์ของทั้งระบบ ว่ามีความเสถียร แม่นยำ และต่อเนื่องหรือไม่ ซึ่งในขั้นตอนนี้จะต้องเป็นขั้นตอนที่รันอยู่เบื้องหลังอย่างต่อเนื่องค่ะ

- Workflow Integration: ในขั้นตอนนี้เป็นการ Integrate ระบบ Emotions AI ที่เราสร้างขึ้นมาเข้ากับ Workflow ดั้งเดิม ซึ่งจะต้องอาศัยทั้งการเชื่อมต่อข้อมูลกับ Database และแนะนำให้ทุกคนในทีมของเรารู้จักกับระบบนี้

- ประเมินและปรับเปลี่ยนอย่างต่อเนื่อง: Emotion Recognition ก็เหมือนกับ AI ประเภทอื่นๆ ค่ะ ที่ต้องการการพัฒนา ปรับปรุง และปรับเปลี่ยนอยู่เสมอ ตาม Input Data ที่เปลี่ยนแปลงไป ทั้งนี้เพื่อเพิ่มประสิทธิภาพให้กับโมเดลอย่างต่อเนื่อง และทำให้ทั้งระบบสามารถวิเคราะห์ข้อมูลของลูกค้าได้อย่างแม่นยำนั่นเองค่ะ^^

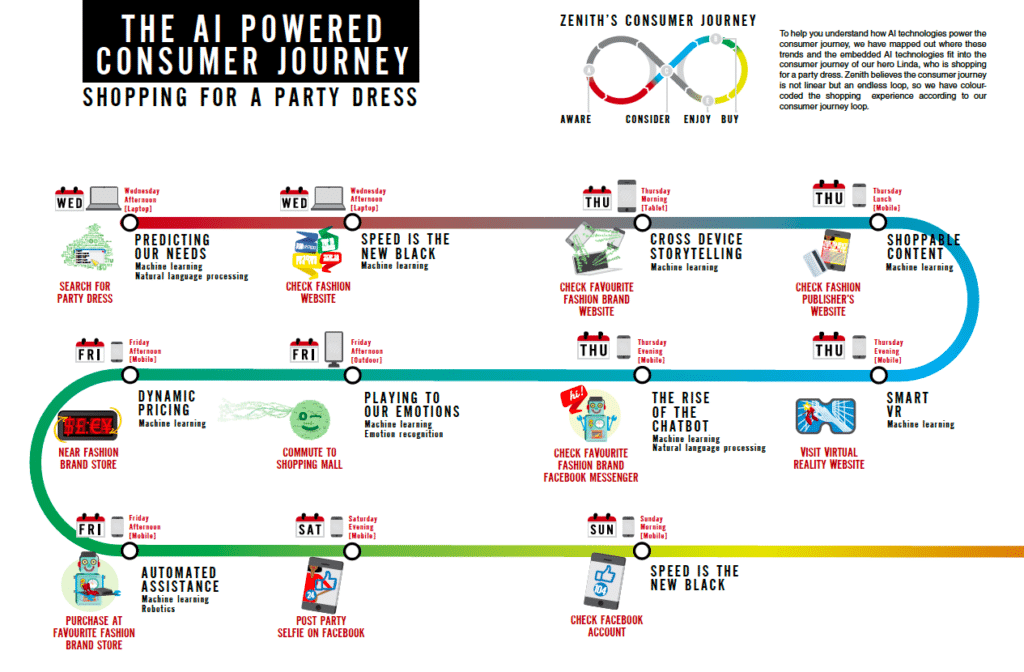

ท้ายสุดนิกของยกตัวอย่าง Consumer Journey ตามภาพด้านล่าง เพื่อให้ทุกท่านเห็นถึงการเดินทางของลูกค้าในการใช้จ่ายตาม Emotion ซึ่งถ้าเราสามารถตรวจจับ และ Predict ได้ย่อมทำให้เราสามารถสร้างประสบการณ์ที่ดีให้กับลูกค้า เพื่อช่วยให้แบรนด์เชื่อมโยงกับลูกค้าได้อย่างลึกซึ้งและมีประสิทธิผล

Last but not Least…

นิกขอสรุป Recape ทั้งบทความดังนี้ค่ะ การใช้งาน Emotion AI ในการตลาดควรเริ่มจากการกำหนดเป้าหมายชัดเจน, ทำความเข้าใจ Emotion Landscape ของลูกค้า, เลือกเครื่องมือ AI ที่เหมาะสม, ทดสอบระบบ, วิเคราะห์ผลลัพธ์ และปรับเปลี่ยนกลยุทธ์อย่างต่อเนื่องเพื่อปรับปรุงประสิทธิภาพ ซึ่งเมื่อทำได้ตามที่ว่ามา Emotion Recognition ไม่เพียงช่วยในการวิเคราะห์การตอบสนองต่อผลิตภัณฑ์หรือโฆษณาของแบรนด์เท่านั้น แต่ยังช่วยให้เราสามารถปรับแต่งข้อความประชาสัมพันธ์ และแคมเปญการตลาดให้ตรงกับอารมณ์และความต้องการของลูกค้าได้ดียิ่งขึ้น

แต่เพื่อนๆ ห้ามลืมคำนึงถึงข้อพิจารณาเชิงจริยธรรมและธรรมภิบาล AI โดยเฉพาะในเรื่องของความแม่นยำ ความเป็นส่วนตัว และข้อกังวลเกี่ยวกับ Bias ต่างๆ ที่เกิดขึ้นในระบบ

สำหรับใครที่อยากอ่านบทความเกี่ยวกับการตลาดเพิ่มเติม สามารถติดตามได้จาก เพจการตลาดวันละตอน และเว็บไซต์ Twitter Instagram YouTube & Blockdit ตาม Links ค่ะ^^

บทความที่เกี่ยวข้อง=>>